L'essor de l'IA pourrait révéler la "stupidité naturelle" des investisseurs

L'intelligence artificielle (IA) est en plein essor, attirant l'attention des universitaires, des capitalistes de risque, des dirigeants d'entreprise et des investisseurs. Cependant, cet engouement pour l'IA pourrait bien révéler ce que le psychologue israélien Amos Tversky appelait la "stupidité naturelle".

L'IA et l'économie comportementale

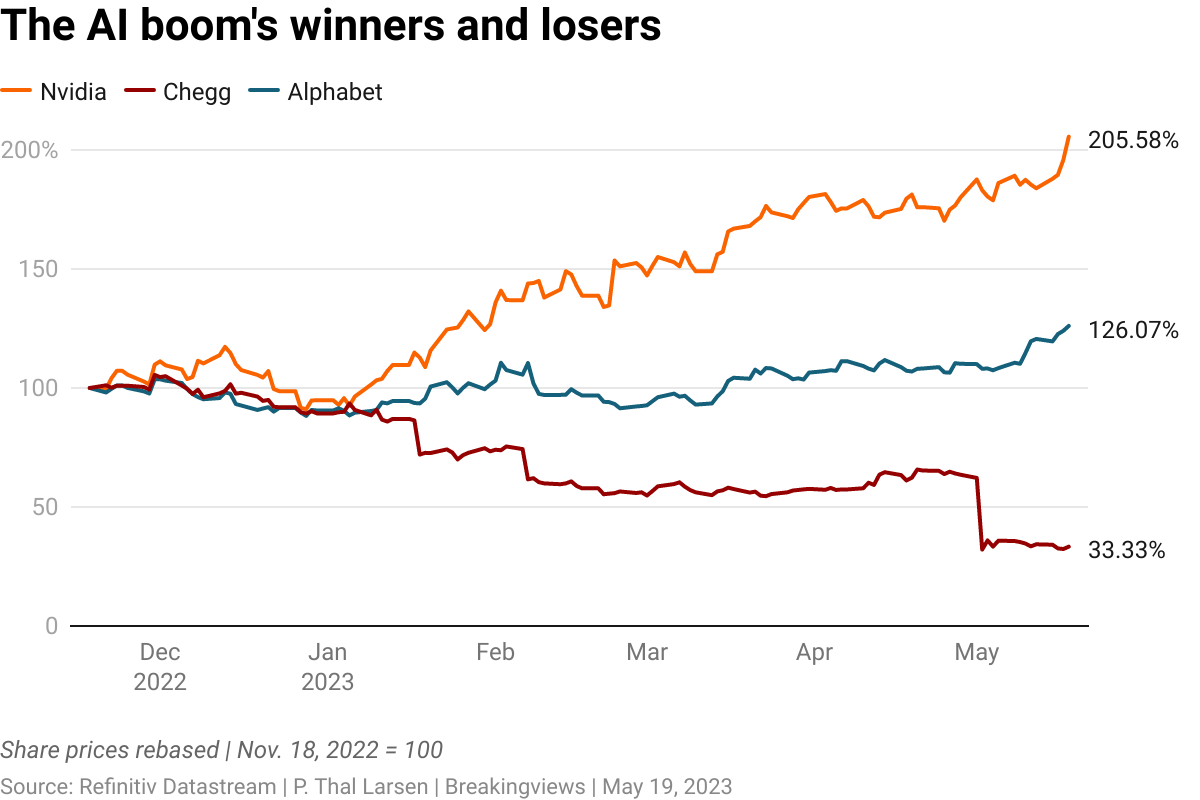

L'économie comportementale, qui étudie comment les facteurs psychologiques, émotionnels et sociaux affectent la prise de décision humaine, a des leçons importantes pour ceux qui espèrent profiter de l'IA. La première leçon est la plus évidente : méfiez-vous des bulles. Depuis la sortie du chatbot ChatGPT d'OpenAI en novembre dernier, le flux constant de capitaux vers tout ce qui est lié à l'IA s'est transformé en torrent. Les actions de Nvidia, le premier fabricant mondial de puces utilisées dans la création d'IA, ont augmenté de plus de 100% au cours des six derniers mois.

Les dangers de l'IA pour les investisseurs

Les modèles de valorisation des actifs orthodoxes suggèrent que ces fluctuations sauvages reflètent des évaluations changeantes mais rationnelles de la rentabilité future. Cependant, l'économie comportementale a longtemps fourni une explication alternative en énumérant une galerie de vauriens de défauts systématiques dans la prise de décision humaine. Ces défauts vont de l'effet de troupeau et de la surconfiance au biais de confirmation et à la peur de manquer quelque chose. C'est un bon moment pour les investisseurs d'être particulièrement vigilants face à la tendance de la stupidité naturelle à pousser les valorisations boursières à des niveaux irréalistes - et donc finalement non rentables - extrêmes.

L'IA peut-elle tenir ses promesses ?

La question la plus fondamentale est la suivante : la nouvelle génération d'IA tiendra-t-elle ses promesses ? L'IA a déjà obtenu des résultats impressionnants. En novembre 2020, AlphaFold de Google DeepMind a stupéfié le monde scientifique en réalisant un changement d'étape dans l'un des grands défis de la biologie moléculaire. Il a prédit les structures dans lesquelles les protéines se "plient" uniquement sur la base des séquences de leurs acides aminés constitutifs.

L'IA et les défis de l'application dans le monde réel

Le grand inconnu est de savoir si l'IA sera capable de reproduire cette extraordinaire capacité de prédiction dans des domaines de la vie commerciale, financière et politique où les règles sont plus floues. L'économie comportementale offre quelques contes de mise en garde pour de telles tentatives d'appliquer l'IA dans le monde réel.

Un gremlin potentiel est le problème du soi-disant biais d'échantillonnage lors de la construction de modèles prédictifs basés sur l'apprentissage statistique. Le problème est que les

L'IA et les défis de l'application dans le monde réel (suite)

Le problème est que les ensembles de données utilisés pour former les modèles peuvent omettre des événements rares mais conséquents. Par exemple, les rendements du marché boursier peuvent être affectés par un petit nombre de mouvements rares mais extrêmes des cours des actions. En conséquence, les entreprises de trading quantitatif ont souvent évité les stratégies de data mining pures en faveur d'approches dans lesquelles la probabilité de risques de queue est supposée plutôt qu'apprise. Les investisseurs moins techniquement avertis adoptent leur propre version de la même tactique lorsqu'ils déploient des heuristiques simples comme la "marge de sécurité" de l'investisseur légendaire Benjamin Graham.

Les économistes comportementaux ont décrit le problème du biais d'échantillonnage en étudiant comment les humains apprennent. Mais les réseaux neuronaux peuvent souffrir des mêmes lacunes. Les machines intelligentes, pas plus que les humains naturellement stupides, devront affronter le fait irritant que l'absence de preuve n'est presque jamais une preuve d'absence.

La loi de Goodhart et l'IA

Ensuite, il y a peut-être le problème le plus frustrant de tous lorsqu'il s'agit de modéliser et de manipuler le comportement humain : la loi de Goodhart. C'est le paradoxe, formulé pour la première fois par l'officiel de la Banque d'Angleterre Charles Goodhart en 1975, selon lequel lorsqu'une mesure devient un objectif de politique, elle cesse d'être une mesure fiable. Par exemple, les agrégats monétaires étaient autrefois de bons prédicteurs de l'inflation. Mais lorsque les banques centrales ont adopté des objectifs basés sur ces chiffres, la corrélation stable a disparu.

La racine de ce problème est que les systèmes humains sont intrinsèquement adaptatifs d'une manière que les systèmes physiques ne le sont pas. Les gens comprennent et tentent de déjouer les efforts pour prédire leur comportement s'ils sentent que cela va à l'encontre de leurs intérêts. Les acides aminés impliqués dans le pliage des protéines ne le font pas.

Conclusion

Les investisseurs seraient fous d'ignorer les résultats spectaculaires que l'IA a produits jusqu'à présent. Mais en ce qui concerne les applications plus larges, ils devraient avancer avec prudence. L'intelligence artificielle peut avoir plus en commun avec la stupidité naturelle que les humains - ou les machines - ne le pensent actuellement.