NVIDIA facilite la création de systèmes conversationnels sécurisés et fiables avec l'IA et le NLP

Les grands modèles de langage (LLM) sont incroyablement puissants, capables de répondre à des questions complexes, d'effectuer des prouesses en matière de rédaction, de développer et de déboguer du code source, et bien plus encore. Cependant, développer des applications LLM sécurisées est difficile. NeMo Guardrails est une boîte à outils open-source pour développer facilement des systèmes conversationnels LLM sécurisés et fiables, conçus pour être compatibles avec tous les modèles, y compris ChatGPT d'OpenAI.

NeMo Guardrails : faciliter le développement

NeMo Guardrails permet aux développeurs de guider facilement les chatbots en ajoutant des règles programmables pour définir les interactions souhaitées. Il prend en charge nativement LangChain, ajoutant une couche de sécurité et de fiabilité aux applications conversations basées sur LLM. Les développeurs peuvent intégrer ces garde-fous dans n'importe quelle application en utilisant une bibliothèque Python.

Les garde-fous

Les garde-fous sont des contraintes programmables qui se placent entre un utilisateur et un LLM. Ils surveillent et dictent les interactions de l'utilisateur avec le bot. NeMo Guardrails est construite sur Colang, un langage de modélisation et un environnement d'exécution développés par NVIDIA pour l'intelligence conversationnelle artificielle.

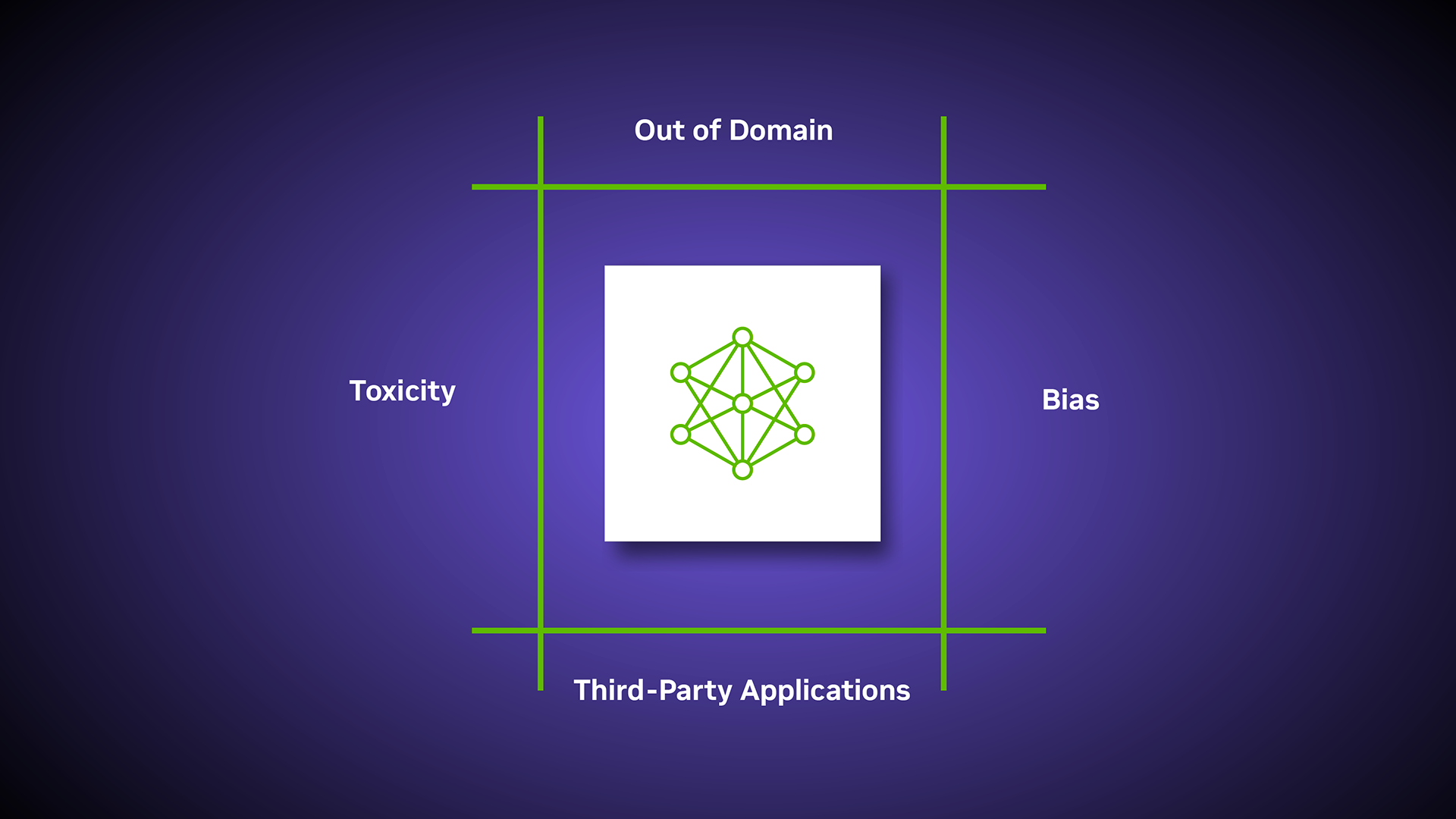

Les techniques de garde-fous

Les garde-fous topicaux assurent le maintien de conversations sur un sujet précis. Les garde-fous de sécurité garantissent que les interactions avec un LLM ne produisent pas de désinformation, de réponses toxiques ou de contenu inapproprié. Enfin, les garde-fous de sécurité empêchent un LLM d'exécuter un code malveillant ou d'appeler une application externe d'une manière présentant des risques de sécurité.

Le flux de travail des garde-fous

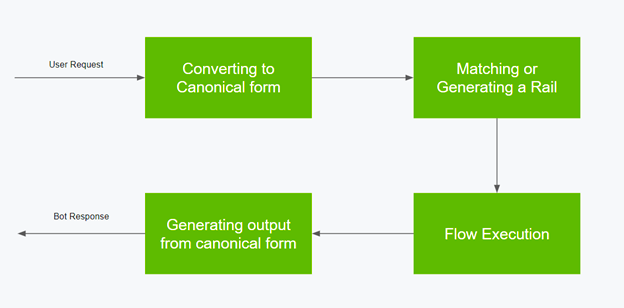

Voici les étapes du flux de travail d'un garde-fou :

- Convertir les entrées de l'utilisateur en une forme canonique.

- Associer ou générer un garde-fou sur la base de la forme canonique, en utilisant Colang.

- Planifier et dicter les étapes suivantes pour que le bot exécute des actions.

- Générer la sortie finale à partir de la forme canonique ou du contexte généré.

Résumé

NVIDIA intègre NeMo Guardrails dans le framework NeMo, qui comprend tout ce dont vous avez besoin pour former et régler des modèles linguistiques en utilisant l'expertise et les données de votre entreprise. NeMo est également disponible en tant que service, faisant partie de NVIDIA AI Foundations, une famille de services cloud pour les entreprises souhaitant créer et exécuter des modèles d'IA personnalisés basés sur leurs propres ensembles de données et connaissances.

NVIDIA souhaite continuer à travailler avec la communauté de l'IA pour rendre la puissance des LLM fiables, sécurisés et accessibles à tous. Explorez NeMo Guardrails dès aujourd'hui.

Source : NVIDIA