Qu'est-ce qu'un modèle de langage dans l'Intelligence Artificielle (Language Model) ?

Les modèles de langage - également appelés "modèles linguistiques" - jouent un rôle essentiel dans le domaine du traitement automatique du langage (TAL) et de l'intelligence artificielle (IA). Dans cet article, nous allons explorer la notion de modèle de langage, son mode de fonctionnement et ses diverses applications.

La notion de modèle de langage

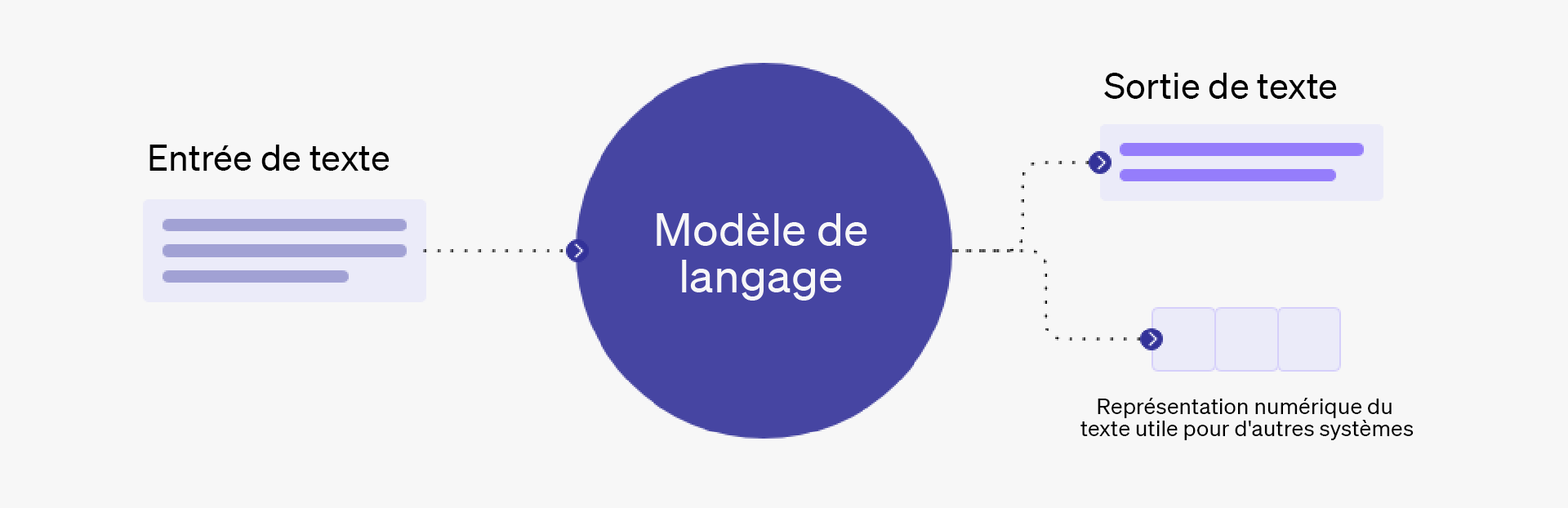

Un modèle de langage est un modèle mathématique qui permet à une machine de comprendre et de générer du texte humain. Son principal objectif est de prédire la probabilité qu'un mot ou une séquence de mots apparaisse dans une phrase.

Il existe plusieurs types de modèles de langage qui fonctionnent sur différents principes, tels que les modèles n-grams, les réseaux de neurones récurrents (RNN) et plus récemment, les large language models (LLM).

Les Modèles n-grams

Un modèle n-gram est un modèle statistique qui calcule la probabilité d'un mot donné en se basant sur les n-1 mots précédents. Par exemple, un modèle de trigram (n = 3) prendra en compte les deux mots précédents pour prédire un mot.

Les Réseaux de neurones récurrents (RNN)

Les RNN sont un type de modèle de langage basé sur les réseaux de neurones artificiels. Ils sont particulièrement adaptés à la modélisation de séquences de données, telles que le texte ou les séries temporelles. Les RNN sont capables de prendre en compte les mots précédents pour prédire le mot suivant, ainsi que d'apprendre et de mémoriser les informations dans de longues séquences de texte.

Les Large Language Models (LLM)

Les LLM sont des modèles linguistiques basés sur des réseaux de neurones profonds et une architecture appelée "Transformateurs". Ces modèles ont révolutionné le domaine du traitement du langage naturel en étant capables de comprendre et de générer du texte avec une précision et un naturel sans précédent.

Pour en savoir plus sur les LLM, consultez notre article détaillé sur le sujet.

Comment fonctionnent les modèles de langage

Les modèles de langage apprennent à partir d'un vaste ensemble de données textuelles pour comprendre et reproduire les structures, les règles et les nuances du langage humain. Ils sont entraînés à partir de techniques d'apprentissage supervisé ou non supervisé, qui les aident à prédire le mot ou le caractère suivant dans une séquence, en se basant sur les mots précédents.

Applications des modèles de langage

Les modèles de langage jouent un rôle clé dans différentes applications liées au traitement automatique du langage, telles que :

- Traduction automatique : Les modèles de langage aident à traduire du texte d'une langue à une autre avec une précision et une fluidité impressionnantes.

- Correction automatique : Les modèles de langage peuvent détecter et corriger les erreurs grammaticales et orthographiques dans un texte.

- Reconnaissance vocale : Les modèles de langage permettent de convertir la parole en texte, ce qui facilite les interactions homme-machine et les fonctions de commande vocale.

- Génération de texte : Les modèles de langage, en particulier les LLM, peuvent générer du texte de manière automatisée pour diverses applications, telles que la rédaction de contenu, les résumés ou les réponses aux questions.

Où trouver des modèles de langage ?

La plus grande bibliothèque de modèles de langage open-source se trouve sur la plateforme communautaire HuggingFace :

Voir aussi :

Conclusion

Les modèles de langage sont des outils puissants qui permettent aux machines de comprendre et générer du texte humain. Ils jouent un rôle essentiel dans diverses applications de traitement automatique du langage et d'intelligence artificielle. Bien que les LLM soient la nouvelle génération de modèles de langage, les modèles n-grams et les réseaux de neurones récurrents continuent de jouer un rôle important dans de nombreuses tâches liées à la compréhension et au traitement du langage humain.