Fuite de document chez Google : Les modèles open source vont surpasser Google et OpenAI

Une fuite d'un document interne de Google révèle que l'Intelligence Artificielle (IA) open source devrait rapidement surpasser les plateformes propriétaires comme Google et OpenAI.

La liste des LLMs et alternatives open-source à ChatGPT que vous devriez connaître ! 👇

— PandIA 🐼 (@pandIA_fr) April 13, 2023

N'hésitez pas à partager d'autres projets similaires en commentaire. 🤗 pic.twitter.com/KdXO4dwEug

L'émergence des modèles IA open source

Selon le document, l'IA open source progresse de manière impressionnante, et les modèles propriétaires tels que ceux de Google et OpenAI ne pourront plus rivaliser. La fuite indique que les modèles open source sont plus rapides, plus personnalisables, plus privés et plus performants. De plus, ils sont disponibles à un coût bien inférieur à celui des géants comme Google. Certains exemples comprennent :

- Des modèles linguistiques massivement multitâches (LLMs) pouvant être exécutés sur un smartphone à une vitesse de 5 tokens par seconde.

- Des IA personnalisables en une soirée à l'aide d'un ordinateur portable.

- Des modèles d'art sans aucune restriction disponible sur des sites web.

- Des fonctionnalités multimodales avancées.

Le document révèle également que ces améliorations incroyables sont le résultat d'une coopération et d'une innovation constante entre la communauté scientifique et les chercheurs indépendants.

Conséquences pour les acteurs en IA

Cette progression spectaculaire de l'IA open source a des implications sérieuses pour les acteurs tels que Google et OpenAI. Le document indique que ces entreprises ne pourront plus maintenir leur position face à l'évolution rapide des technologies ouvertes. Il est donc suggéré que Google et OpenAI devraient réévaluer leurs stratégies et envisager de collaborer avec l'écosystème open source.

En outre, le document souligne que Google et OpenAI ne disposent pas d'un avantage concurrentiel secret. Le meilleur espoir serait de partager les connaissances et de tirer parti de l'expertise de la communauté open source pour améliorer la qualité et la rapidité de leur IA.

La nécessité d'un changement de posture pour Google et OpenAI

Le document recommande que Google et OpenAI adoptent une approche plus ouverte et coopérative, en mettant l'accent sur l'intégration dans l'écosystème open source. Un changement de stratégie vers une concentration sur l'open source peut permettre à ces entreprises de rester compétitives et de bénéficier de l'innovation constante de la communauté open source.

En conclusion, ce document interne de Google soulève des points de réflexion importants sur l'avenir de l'IA et la manière dont les entreprises doivent s'adapter au paysage en constante évolution. Dans tous les cas, il est sûr de dire que l'IA open source jouera un rôle de plus en plus important dans les années à venir.

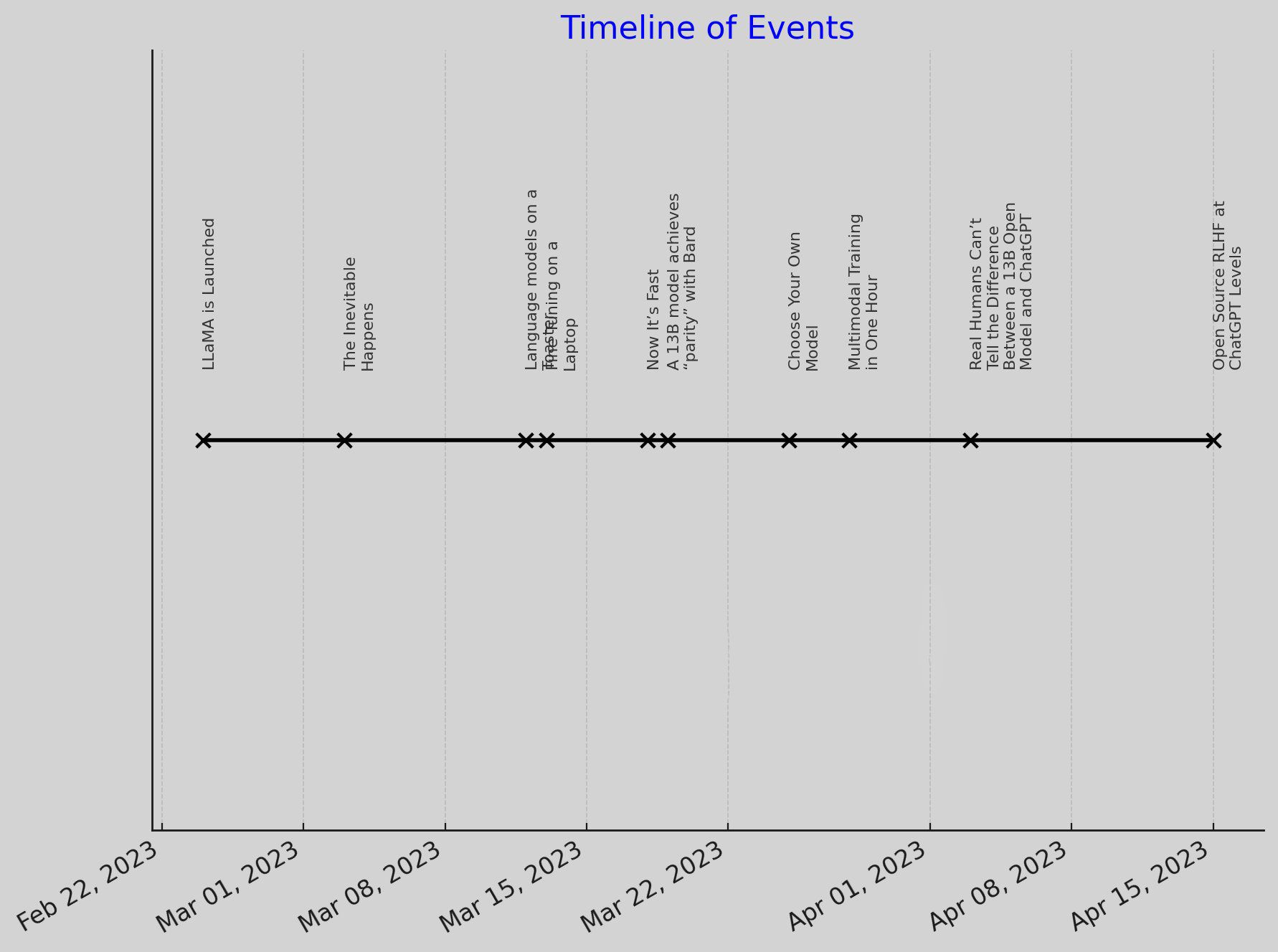

Chronologie des événements

LLaMA : une révolution dans l'intelligence artificielle

24 février 2023 - Meta lance LLaMA en open-source, offrant un accès public au code, mais pas aux poids. À ce stade, LLaMA n'est pas encore conçu pour des conversations ou des instructions.

Fuite de LLaMA et conséquences pour la communauté

3 mars 2023 - LLaMA est divulgué au public, ce qui a un impact considérable sur la communauté. Les licences existantes interdisent une utilisation commerciale, mais tout le monde peut désormais expérimenter avec ce modèle.

LLaMA sur un Raspberry Pi

12 mars 2023 - Artem Andreenko parvient à faire fonctionner le modèle sur un Raspberry Pi. Bien que trop lent pour être pratique, cela ouvre la voie à une série d'efforts de miniaturisation.

Fine-tuning sur un ordinateur portable

13 mars 2023 - Stanford publie Alpaca, qui ajoute l'instruction tuning à LLaMA. Grâce au repo alpaca-lora d'Eric Wang, il est désormais possible de fine-tuner le modèle rapidement et à moindre coût.

LLaMA fonctionne rapidement sur un MacBook

18 mars 2023 - Georgi Gerganov utilise une quantification à 4 bits pour faire fonctionner LLaMA sur un CPU de MacBook. C'est la première solution sans GPU suffisamment rapide pour être pratique.

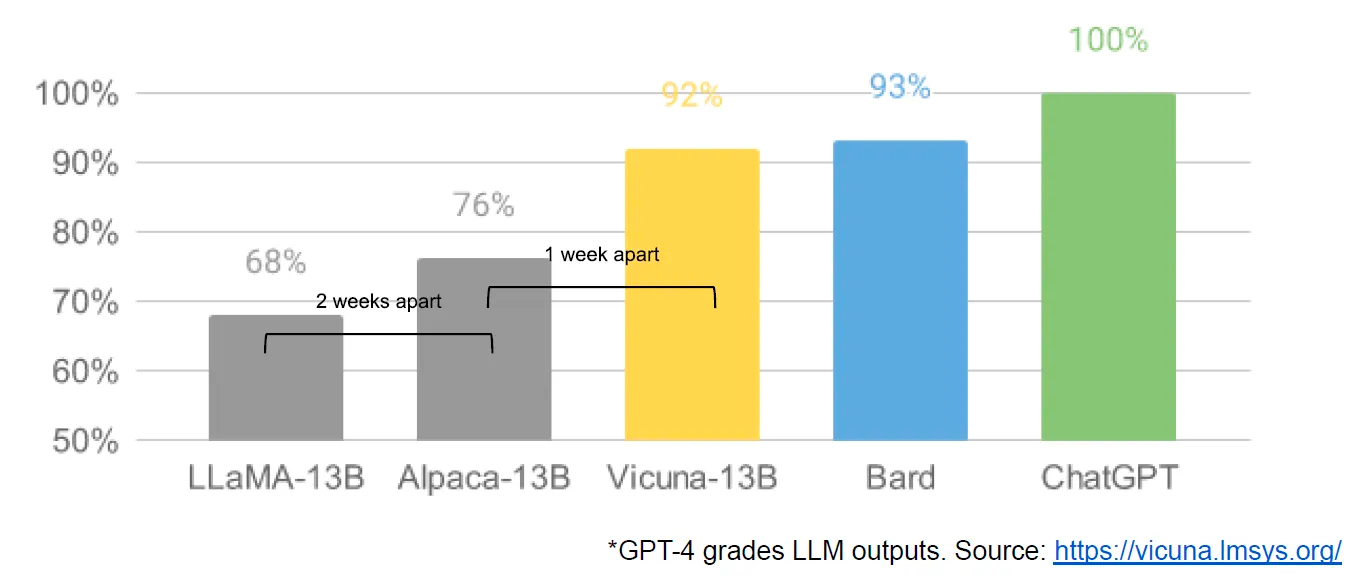

Un modèle de 13B atteint la "parité" avec Bard

19 mars 2023 - Une collaboration inter-universitaire publie Vicuna, qui surpasse les variantes précédentes pour un coût de formation de seulement 300 dollars.

GPT4All : un écosystème de modèles

25 mars 2023 - Nomic crée GPT4All, un écosystème rassemblant différents modèles, dont Vicuna, pour un coût de formation de 100 dollars.

L'open source GPT-3 de Cerebras

28 mars 2023 - Cerebras entraîne l'architecture GPT-3 en utilisant le programme de calcul optimal de Chinchilla et le scaling optimal de μ-paramétrisation. Ces modèles surclassent largement les clones de GPT-3 existants.

Entraînement multimodal en une heure

28 mars 2023 - Grâce à la technique PEFT, LLaMA-Adapter introduit l'instruction tuning et la multimodalité en une heure de formation seulement, avec seulement 1,2 million de paramètres apprenables.

Difficile de distinguer un modèle ouvert de 13B de ChatGPT

3 avril 2023 - Berkeley lance Koala, un modèle de dialogue entraîné entièrement à partir de données librement disponibles. Les utilisateurs préfèrent Koala ou n'ont aucune préférence dans plus de 50 % des cas, comparativement à ChatGPT.

Open Source RLHF au niveau de ChatGPT

15 avril 2023 - Open Assistant lance un modèle et un ensemble de données pour l'alignement via RLHF. Leur modèle est très proche de ChatGPT en termes de préférence humaine. Grâce à cet ensemble de données, il est désormais facile et peu coûteux pour les petits expérimentateurs d'accéder à la technique RLHF. De plus, comme l'ensemble de données est accessible au public, il est possible d'utiliser une pile entièrement ouverte pour exécuter le modèle avec Pythia-12B.

Conclusion

En l'espace de quelques mois, l'intelligence artificielle a connu une série de développements majeurs grâce à LLaMA et aux projets qui en découlent. Ces avancées ont rendu les modèles d'IA plus accessibles, moins coûteux et plus performants, ouvrant ainsi la voie à une myriade d'applications et d'innovations. Les modèles open-source tels que Koala et GPT4All offrent désormais des alternatives crédibles à des solutions propriétaires comme ChatGPT, contribuant à démocratiser l'accès à l'IA et à stimuler la recherche dans ce domaine.